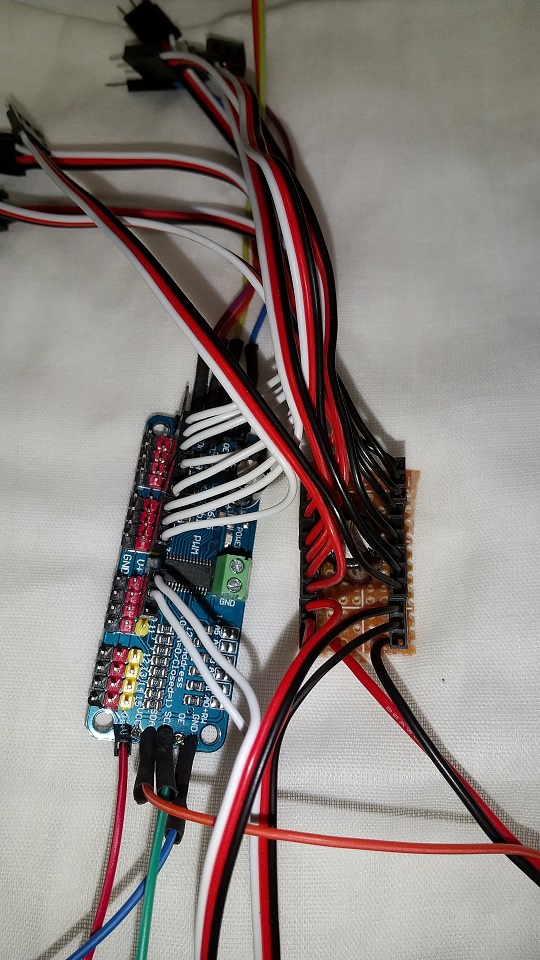

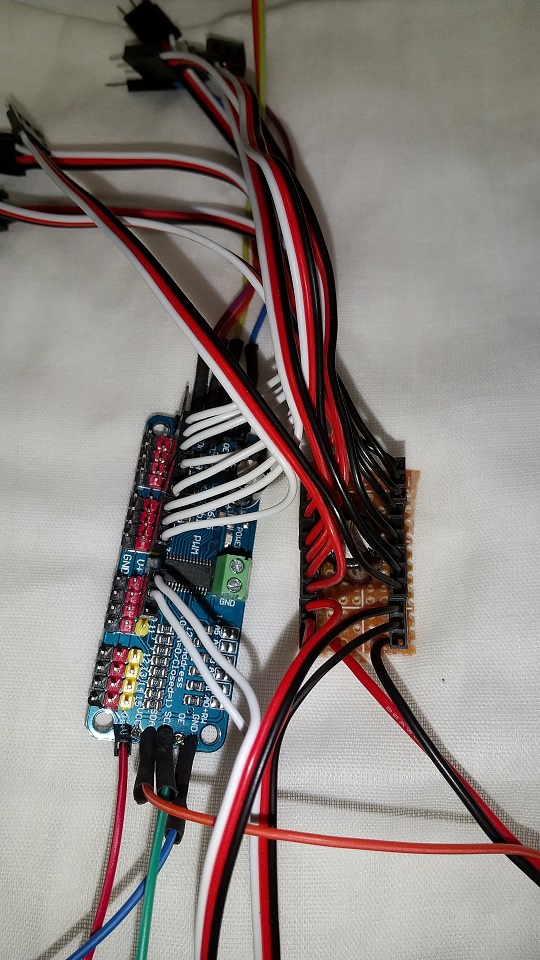

7v側をこんな感じで電源を分離。もともと5V側のものを7Vに流用。V+に線がつながっているのはVCCから電圧が出ていなかったのでV+から故障した7VのVCCに電源を供給したなごり。流用流用。5v側は新しいのを使用する予定。

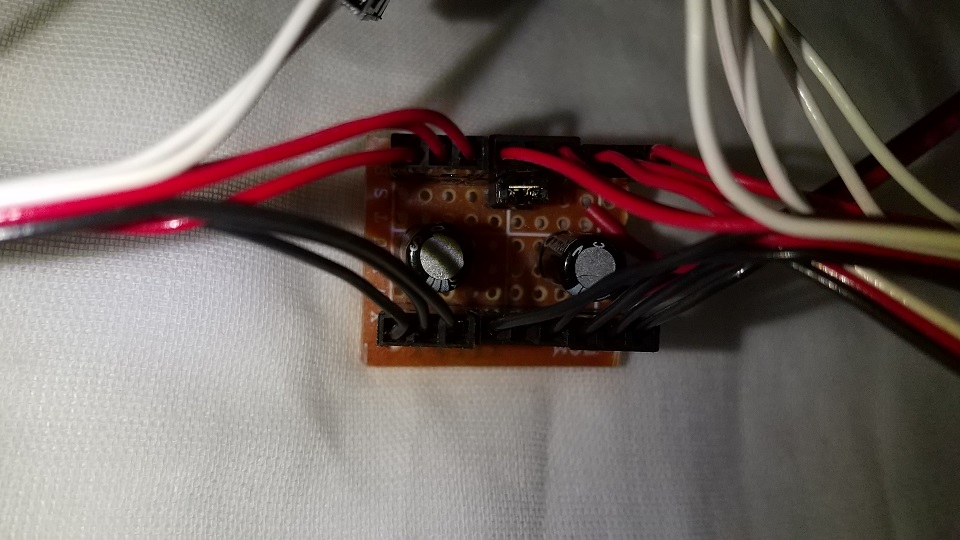

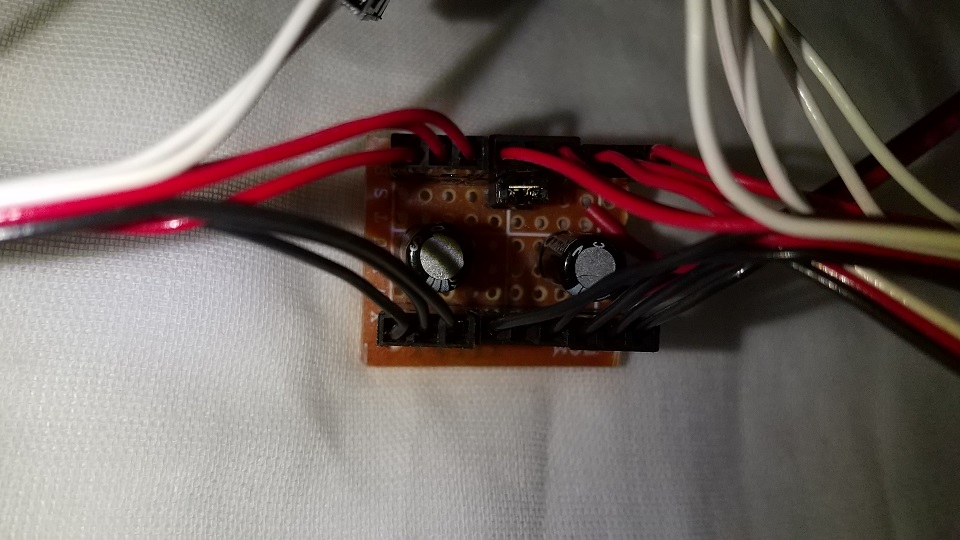

5V側のコンデンサが2個になっているのは、真ん中のジャンパーピンを外すと回路が分離されて、もう一つDC-DC コンバータをつなげられるようにしている、電流不足の疑いを持っているため、この構造にした。

7v側をこんな感じで電源を分離。もともと5V側のものを7Vに流用。V+に線がつながっているのはVCCから電圧が出ていなかったのでV+から故障した7VのVCCに電源を供給したなごり。流用流用。5v側は新しいのを使用する予定。

5V側のコンデンサが2個になっているのは、真ん中のジャンパーピンを外すと回路が分離されて、もう一つDC-DC コンバータをつなげられるようにしている、電流不足の疑いを持っているため、この構造にした。

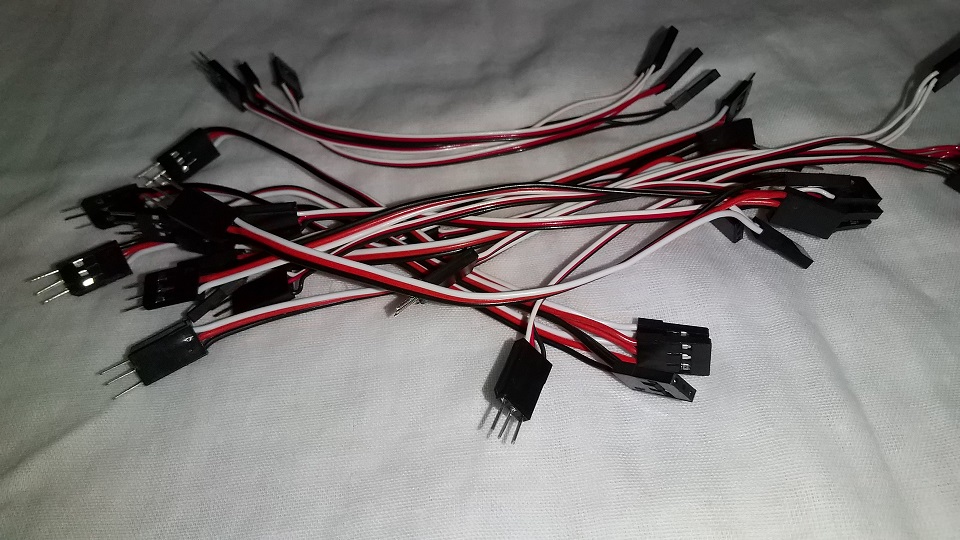

電源周りのために少し特殊なケーブルを作成。

サーボ用電源電圧の問題で信号側に問題が出たのはおかしい気がする。

もう少し調べてみる。

PCA9685は6vが上限と書かれていた。そりゃ7v入れたら壊れるわ。

サーボに7Vはどうやら無理っぽい。信号側の電圧に逆流して色々壊れてるっぽい。

足回りに手がぶつからないようするための機能を追加中。

まずソフトの方を先に仕上げるために上物外して動作確認できるようにした。

いろいろ補強しないとダメそうだ。

久々にロボット動かそうとしたらうまく動かない。まずはサーボの動作確認だから、PC側だけでやろうとしたのだけどうまくいかない。どうやって動作確認してたか思い出さなくては。

を公開しました。

文章にまとめて公開はやっぱり大変だね。

コード部分にコピーボタンを表示するようにしました。

リンクがおかしなところを一か所見つけたので修正しました。